Appleは、iPhoneやその他の製品のAI機能を支えるAIトレーニング能力に関する最新の研究論文で、市場リーダーであるNVIDIAのGPUではなく、GoogleのTPU(Tensor Processing Unit)チップに依存することを選択したことが明らかになりました。これは、AI業界に大きな影響を与える可能性のある重要な動きです。

Appleの論文によると、同社の27億3,000万パラメータを持つApple Foundation Model(AFM)は、Googleが提供する第4世代と第5世代のTPU(Tensor Processing Unit)クラウドクラスターに依存しているとのことです。

AppleのAIアプローチ:GPUではなくTPUを使用

Appleは研究論文の中で、今年のWWDCで発表されたAI機能を支えるAIモデルのトレーニングインフラなどの詳細を明らかにしました。これらのAI機能の中心にあるのがAFMと呼ばれるApple Foundation Modelです。

describing the text models.

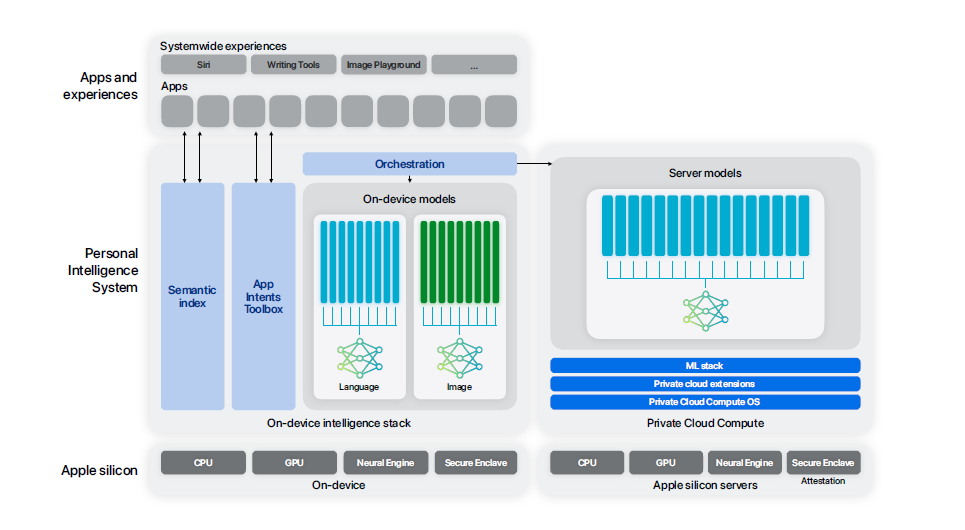

Apple のデバイス内およびクラウド AI 機能の説明。どちらも AFM または AFM 派生のトレーニング手法に依存しています。出典: Apple Intelligence Foundation Language Models Apple

サーバー上のAFMについて、つまりApple Cloud Computeと呼ばれるクラウドAI機能を支えるモデルについて、Appleは「8192個のTPUv4チップ」を使って6.3兆トークンのAIモデルを「ゼロから」トレーニングしていると説明しています。また、AFMモデル(デバイス上とクラウドの両方)がTPUv4チップとv5pクラウドTPUクラスターでトレーニングされていることも明らかにしました。

デバイス上のAIモデルの詳細

ライティングや画像選択などのデバイス上のAI機能については、Appleは「AFM-serverと同じレシピを使ってゼロからトレーニングされた」64億パラメータのモデルを使用しています。このモデルは、2048個の新しいTPU v5pチップでトレーニングされたとのことです。

AppleのAIモデルの性能評価

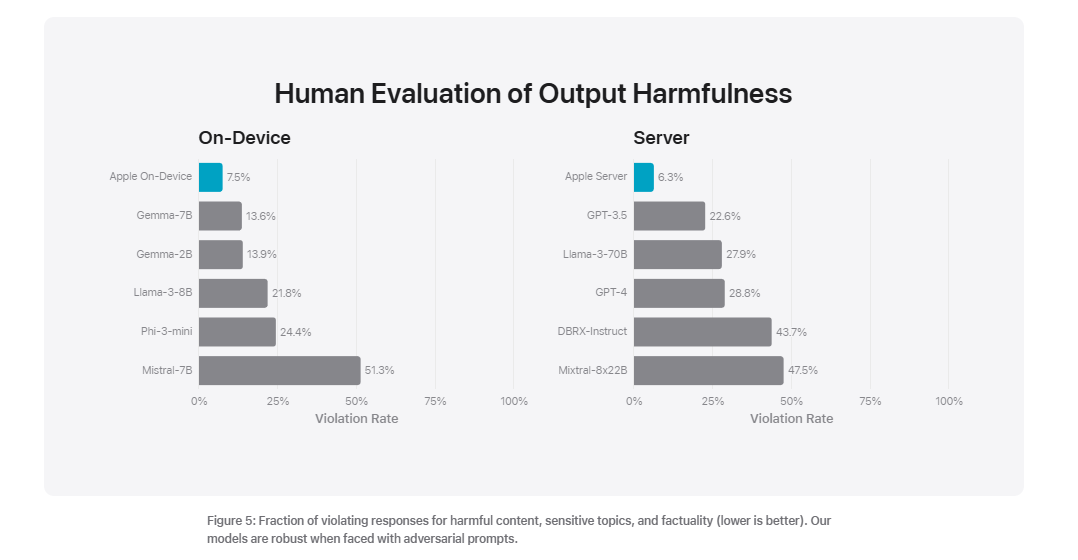

論文では、AIモデルを有害な応答、センシティブなトピック、事実の正確性、数学的パフォーマンス、モデル出力に対する人間の満足度などの観点から評価しています。Appleによると、AFMサーバーとデバイス上のモデルは、有害な出力の抑制において業界をリードしているとのことです。

例えば、AFMサーバーは、OpenAIのGPT-4と比較して、有害な出力違反率が6.3%と、GPT-4の28.8%に比べて大幅に低くなっています。また、メール、メッセージ、通知の要約に関する満足度も、AFMデバイス上モデルが業界をリードしています。

まとめ

Appleの最新の研究論文から、同社がAIトレーニングにおいてNVIDIA GPUではなくGoogleのTPUチップを採用していることが明らかになりました。AFMと呼ばれるAppleのAIモデルは、デバイス上とクラウドの両方でTPUを活用しており、有害な出力の抑制や要約の満足度などで優れた性能を示しています。AppleのAIへの独自のアプローチは、業界に大きな影響を与える可能性があり、今後のAI機能の展開が期待されます。